Energooszczędne chłodzenie centrów danych – dokąd zmierzamy?

![Wykorzystanie technik free coolingu w centrach danych w Europie (100 ze 170 uczestników programu Kodeks Postępowania Efektywności Energetycznej Centrów Danych) [9]

rys. Autorka](https://www.rynekinstalacyjny.pl/media/cache/typical_view/data/202110/energooszczedne-chlodzenie-centrow-danych.jpg)

Wykorzystanie technik free coolingu w centrach danych w Europie (100 ze 170 uczestników programu Kodeks Postępowania Efektywności Energetycznej Centrów Danych) [9]

rys. Autorka

Znaczna energochłonność systemów chłodzenia centrów danych jest postrzegana jako cena ich niezawodności i pewności działania w niemal każdych okolicznościach zewnętrznych. Dążeniom do zmniejszania ilości zużywanej na chłodzenie energii zawsze towarzyszy pytanie, czy można tego dokonać bez wpływu na najważniejsze funkcjonalności klimatyzacji centrów danych? Na to pytanie od lat próbują odpowiedzieć praktycy, niezależne instytucje, naukowcy, a nawet ekolodzy.

Zobacz także

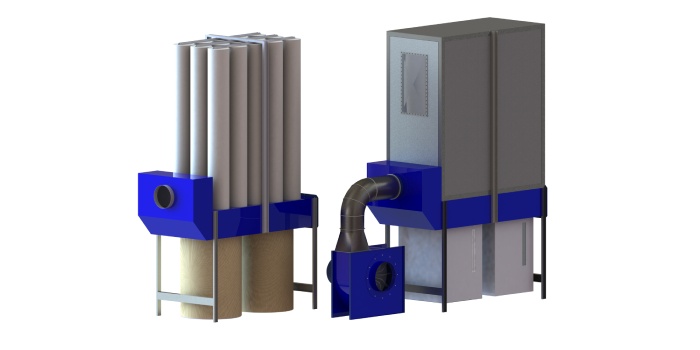

Mastervent Tomasz Miliński Skuteczność odpylania jako istotny aspekt bezpieczeństwa pracy

Emisja pyłów powstających w procesach technologicznych jest jednym z poważniejszych problemów stwarzających zagrożenie dla osób przebywających w ich otoczeniu. Głównymi źródłami pyłów są procesy cięcia...

Emisja pyłów powstających w procesach technologicznych jest jednym z poważniejszych problemów stwarzających zagrożenie dla osób przebywających w ich otoczeniu. Głównymi źródłami pyłów są procesy cięcia materiałów, transportowania, szlifowania i polerowania. Pyły są nie tylko zagrożeniem zdrowotnym, ale również mogą być przyczyną wybuchu.

Mastervent Tomasz Miliński Urządzenia do pochłaniania zanieczyszczeń i obliczanie ilości powietrza odciąganego

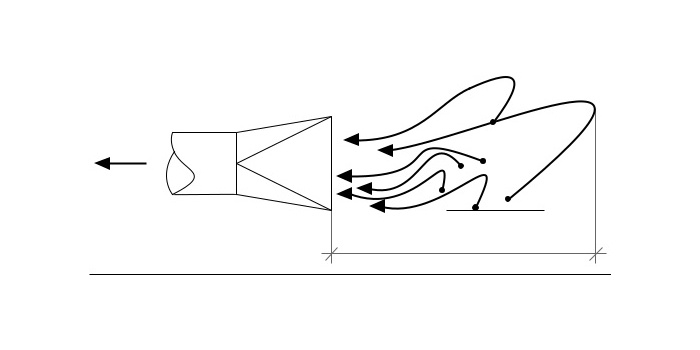

Skuteczny odciąg zanieczyszczonego powietrza to problem wielu zakładów produkcyjnych. Źle wykonana wentylacja miejscowa w miejscu obróbki materiałów może powodować gromadzenie się pyłu na stanowisku pracy...

Skuteczny odciąg zanieczyszczonego powietrza to problem wielu zakładów produkcyjnych. Źle wykonana wentylacja miejscowa w miejscu obróbki materiałów może powodować gromadzenie się pyłu na stanowisku pracy oraz w jego okolicach, co w konsekwencji może doprowadzić do powstania tzw. obłoku pyłowego, a niewielkie zaiskrzenie mechaniczne lub otwarty ogień mogą spowodować wybuch.

Panasonic Marketing Europe GmbH Sp. z o.o. Energooszczędne rozwiązania grzewcze i chłodnicze dla hoteli

Podczas projektowania obiektów hotelarskich coraz ważniejsze dla architektów oraz projektantów branżowych stają się kwestie związane z racjonalnym zużyciem energii. Efekt ten jest osiągany poprzez zastosowanie...

Podczas projektowania obiektów hotelarskich coraz ważniejsze dla architektów oraz projektantów branżowych stają się kwestie związane z racjonalnym zużyciem energii. Efekt ten jest osiągany poprzez zastosowanie rozwiązań architektoniczno-budowlanych, które zmniejszają potrzeby cieplne budynku oraz likwidują mostki termiczne. Stosuje się też systemy instalacyjne, które zapewniają odpowiedni komfort cieplny, zmniejszają koszty eksploatacyjne budynku oraz podnoszą prestiż ekologiczny obiektu. Jakie rozwiązania...

W artykule:• Jak efektywnie schładzać serwery o coraz większej gęstości mocy?

|

Odpowiedzi na tytułowe pytanie jest tyle, co pomysłodawców. Dlatego w poniższym opracowaniu omówiono tylko wybrane trendy – szczególnie ciekawe lub wskazywane przez ekspertów branżowych.

Jak efektywnie schładzać serwery o coraz większej gęstości mocy?

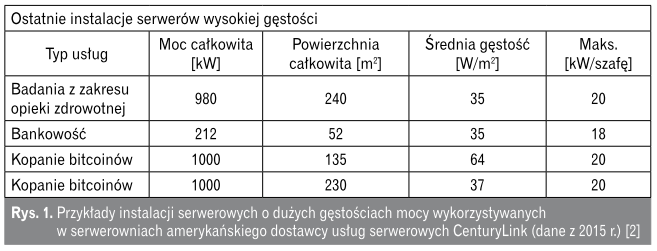

Jednym z trendów w rozwoju centrów danych, który nie jest jeszcze dominujący, ale nie powinien być ignorowany [1], jest wzrost gęstości mocy serwerów (kW/szafę). Rosnąca gęstość mocy wiąże się m.in. z upowszechnianiem nowych technologii opartych na przetwarzaniu ogromnych zbiorów danych, takich jak internet rzeczy, sztuczna inteligencja, technologia blockchain, kopanie kryptowalut itp.

Jak wynika z corocznych badań ankietowych prowadzonych przez Uptime Institute (organizację badawczo-konsultingową zajmującą się zwiększaniem wydajności i skuteczności centrów przetwarzania danych), średnia gęstość mocy wynosi obecnie 8,4 kW/szafę [1]. Od 2018 roku większość respondentów wskazuje, że najwyższa osiągana w ich obiektach wartość wynosi między 10 a 19 kW/szafę. Jak wskazano w opracowaniu wyników badań, dopiero serwerownie o gęstości 20–25 kW/szafę wymagają zdecydowanej zmiany podejścia przy chłodzeniu – bardziej efektywne staje się wówczas bezpośrednie chłodzenie cieczowe oraz powietrzna klimatyzacja precyzyjna [1]. Dla gęstości przekraczającej 40 kW/szafę obciążenia cieplne będą tak duże, że konieczne będzie zastosowanie cieczowego układu chłodzącego [3].

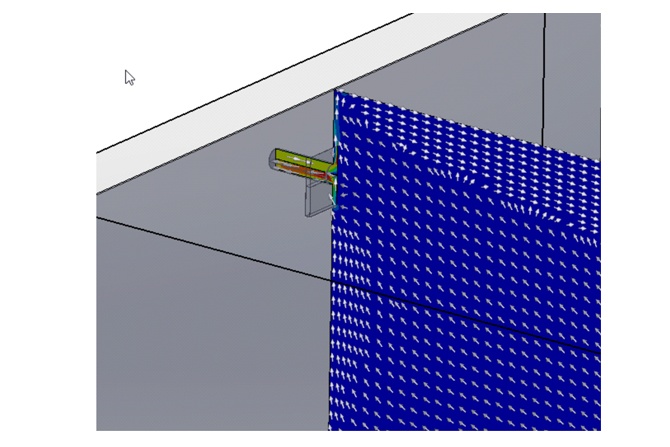

Aby uświadomić sobie, o jakich wielkościach strumienia powietrza chłodzącego mowa, warto przytoczyć analizę wykonaną przez Schneider Electric [4]. Wskazano w niej, że serwer kasetowy o mocy 18 kW dla prawidłowej pracy wymaga dostarczenia 1,18 m3/s powietrza chłodnego do obudowy, odprowadzenia takiej samej ilości powietrza gorącego oraz utrzymywania gorącego powietrza wylotowego z dala od wlotu powietrza do urządzenia (tego konkretnego oraz sąsiadujących) [4].

Ważnym kierunkiem związanym z poprawą wydajności systemu chłodzenia (a tym samym bardziej ekonomicznym wykorzystaniem jego możliwości) w aspekcie gęstości mocy i „zarządzania” chłodzeniem jest decentralizacja urządzeń chłodniczych w pomieszczeniu serwerowni.

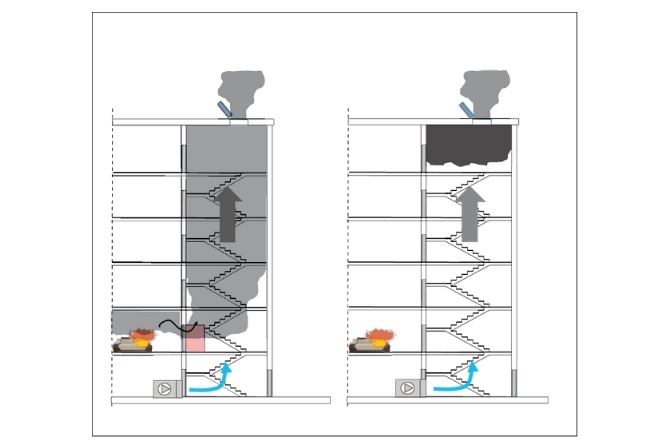

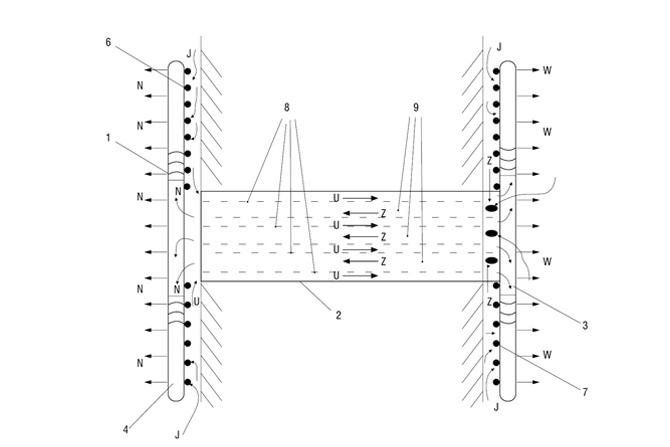

Klasycznym rozwiązaniem jest chłodzenie całego pomieszczenia. Nie w pełni sprawdza się ono jednak w odniesieniu do centrów opartych na serwerach o dużej gęstości. Rozwiązanie to w dużym stopniu zależy od warunków danego pomieszczenia i nawet jeśli zapewnia sumaryczną wydajność odpowiednią dla wytwarzanej mocy cieplnej, może ona nie być wykorzystywana w pełni. Dzieje się tak np., gdy przepływ powietrza omija urządzenia IT i przepływa bezpośrednio z powrotem do urządzenia chłodniczego – nie zapewnia chłodzenia, a zatem obniża jego całkowitą wydajność. W systemie tym konieczne jest bardzo dokładne zaplanowanie architektury pomieszczenia, z układem podłóg podniesionych oraz tzw. zimnych i ciepłych korytarzy, dzięki którym strumienie powietrza nie będą się mieszać.

System chłodzenia rzędowego (jeden układ chłodzący do obsługi jednego rzędu szaf) jest bardziej precyzyjny i przewidywalny, struga powietrza przebywa krótszą drogę, a jej przepływ jest dobrze ukierunkowany. Takie rozwiązanie umożliwia wykorzystanie pełnej mocy znamionowej, a tym samym obsługę urządzeń IT o większej gęstości. Możliwa jest także większa sprawność dzięki mniejszej wymaganej mocy wentylatorów. Przejście z chłodzenia pomieszczeń na system rzędowy pozwala na zmniejszenie kosztów energii elektrycznej średnio o 35% [5].

Systemy chłodzenia pojedynczych szaf w jeszcze większym stopniu wykorzystują zalety dobrze ukierunkowanego, przewidywalnego strumienia powietrza i pełnego wykorzystania mocy. Takie zdecentralizowane chłodzenie szczególnie dobrze sprawdzi się w przypadku szaf o wysokiej gęstości (maks. 50 kW na szafę). Zasadniczą wadą tego rozwiązania jest konieczność zastosowania dużej liczby urządzeń chłodzących wraz ze związanymi z nimi instalacjami rurowymi.

W wielu przypadkach korzystne jest rozwiązanie mieszane. Ciekawy przykład takiego rozwiązania podano w [6], odwołując się do rozbudowy chłodzonej serwerowni jako całego pomieszczenia poprzez wyposażenie niewielkiej grupy rzędów lub szaf wysokiej gęstości w specjalne systemy chłodzenia. W ten sposób urządzenia wysokiej gęstości są wydzielane z pomieszczenia jako „termicznie obojętne”, a obsługujące je urządzenia mogą wręcz korzystnie oddziaływać na resztę pomieszczenia, zwiększając wydajność chłodniczą dla jego pozostałej części [6].

Jak zużyć mniej prądu, nie tracąc na niezawodności?

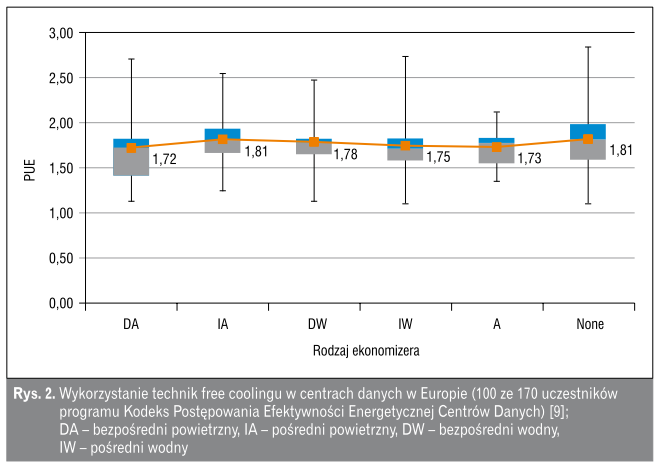

O 40-proc. udziale urządzeń chłodniczych w całkowitym zużyciu energii przez centra danych wiedzą wszyscy, którzy kiedykolwiek zetknęli się z tą kwestią. Nikogo nie dziwi więc, że od dobrych kilku lat szuka się rozwiązań, które umożliwią zmniejszenie poboru prądu przez systemy sprężarkowe. Obok zwiększania ich efektywności oraz stosowania sterowania, które dopasowuje pracę urządzeń chłodzących do aktualnego obciążenia cieplnego obsługiwanych serwerów, istotnym trendem jest poszukiwanie rozwiązań uzupełniających, „ekonomizujących” pracę centrów danych. Kluczową kwestią pozostaje jednak niezawodność i gwarancja dostępności (w sensie operacyjnym) tych rozwiązań, która dla centrów danych musi być znacznie wyższa niż np. dla zastosowań komercyjnych.

Wybierając technologię zwiększającą efektywność chłodzenia, należy wziąć pod uwagę spełnienie przez nią wymagań związanych z certyfikacją Tier. Może się zdarzyć, że nawet wydajna i mająca świetne charakterystyki technologia nie znajdzie zastosowania w centrum danych, ponieważ nie była przygotowywana z uwzględnieniem jego specyfiki i nie umożliwi przejścia procesu certyfikacji (np. odporność na awarie wymagana przy poziomie Tier IV). Patrząc od strony oszczędności, należy także zwrócić uwagę na zużycie wody, szczególnie w regionach lub lokalizacjach zagrożonych jej niedoborem.

Wśród technologii „ekonomizujących” stosowane są m.in. [2, 7, 8]:

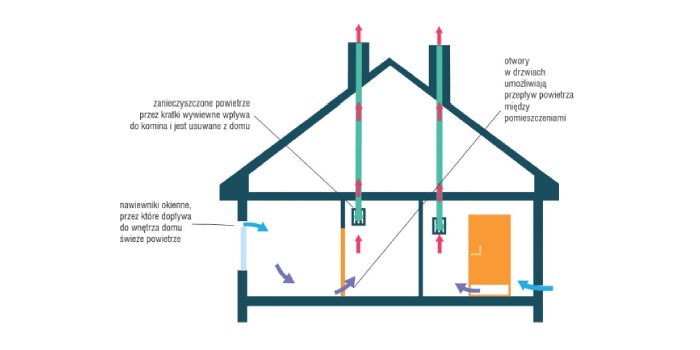

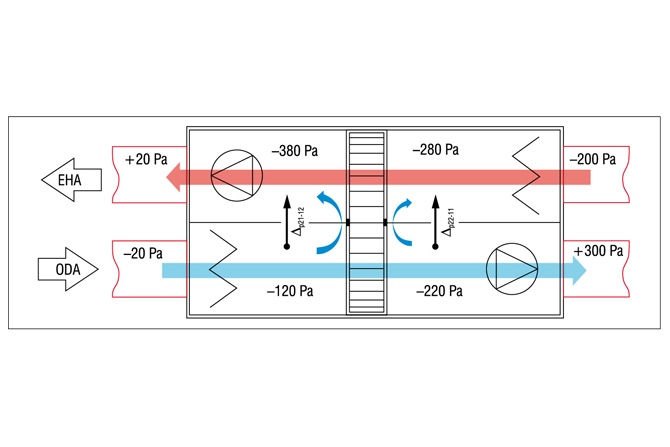

- chłodzenie bezpośrednie – nawiew chłodnego, zwykle przefiltrowanego powietrza zewnętrznego bezpośrednio do centrum danych. Urządzenia występują zwykle jako rooftopy, łącząc chłodzenie bezpośrednie powietrzem zewnętrznym z rozprężaniem bezpośrednim (DX) lub wodą lodową. Są stosunkowo niedrogie, mogą też zapewnić znaczne oszczędności eksploatacyjne. Niektóre z nich mogą wymagać dodatkowego modułu filtracyjnego (mogą nie mieć podzespołów filtracyjnych wystarczających do zapewnienia właściwego składu powietrza dla urządzeń wrażliwych na zanieczyszczenia pyłowe). Ważne jest także zapewnienie odpowiedniego sterowania, które musi być każdorazowo dobrane do konkretnego zastosowania. Tego typu urządzenia często są bowiem urządzeniami komercyjnymi, które nie zostały opracowane dla centrów danych i wobec tego mogą nie spełniać szczególnych surowych wymagań dla parametrów i ich stałości w centrum danych;

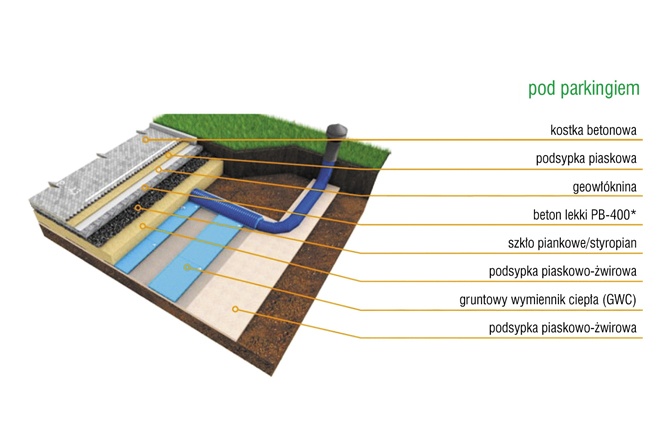

- pośrednie chłodzenie adiabatyczne – chłodzenie powietrza technikami ewaporacyjnymi przed nawiewem do centrum danych. Powietrze schłodzone technikami ewaporacyjnymi jest medium pośrednim, chłodzącym właściwe powietrze bez kontaktu z nim. Dzięki temu unika się zanieczyszczeń pochodzących z powietrza zewnętrznego, łatwiej też o kontrolę wilgotności. Współpracując z klasycznym systemem sprężarkowym, ograniczają jego stosowanie. Na dalekiej Północy mogą wręcz pracować samodzielnie, ale nawet w cieplejszym klimacie we współpracy z systemem odparowania bezpośredniego (DX) umożliwią oszczędności energii elektrycznej. Wymagają starannego wymiarowania i doboru. Ważne jest też zwrócenie uwagi na spełnienie wymagań certyfikacji Tier przez wodę przeznaczoną do chłodzenia ewaporacyjnego oraz urządzenia wodne;

- dry coolery (chłodnice suche) pompowanego czynnika chłodniczego – zamknięta pętla umożliwia wyrzut ciepła do powietrza zewnętrznego i chłodzenie centrum danych. Urządzenie chłodzące z tą funkcją przypomina klasyczne urządzenie klimatyzacji precyzyjnej, ale zamiast sprężarki wyposażone jest w wentylator i chłodnicę, przez którą ciepło wyrzucane jest na zewnątrz, bez przemiany fazowej ciecz-gaz. Jest to rozwiązanie stosunkowo tanie, niewymagające zastosowania wody i łatwe w konserwacji;

- ekonomizer po stronie wodnej – zastosowanie tradycyjnych wież chłodniczych z wykorzystaniem wymienników ciepła. Urządzenia te są stosunkowo łatwe do zastosowania w już istniejących, modernizowanych centrach danych. Zimą w klimacie umiarkowanym (i klimatach ostrzejszych) możliwe jest wykorzystanie wyłącznie wież chłodniczych, bez uruchamiania agregatu wody lodowej. Kluczowymi czynnikami są automatyka i sterowanie, które będą pozwalały na skuteczne przełączanie między trybami pracy. Jest to rozwiązanie stosunkowo kosztowne przy montażu.

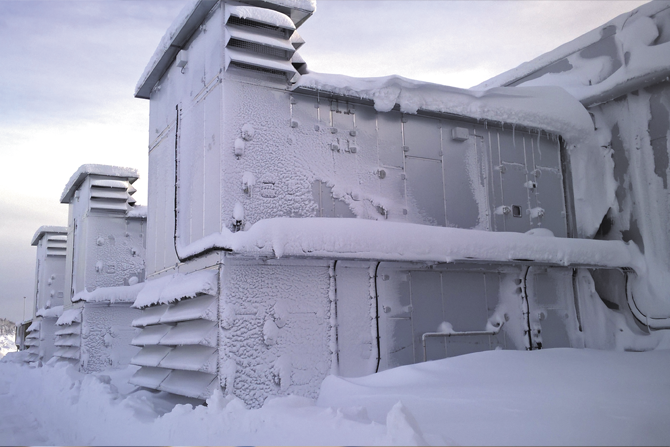

Umożliwienie jak najszerszego wykorzystania najłatwiej dostępnego free coolingu jest źródłem kolejnego ciekawego trendu, wskazywanego w różnych opracowaniach [8, 9, 10]. Jest nim lokalizowanie centrów danych, także przez potężne, wiodące w swoich sektorach firmy z branży cyfrowej, w regionach na dalekiej Północy. Badacze wspominają o strefie subarktycznej lub wręcz arktycznej, ale już w krajach skandynawskich można wykorzystywać nieograniczoną energię odnawialną – zimne powietrze o odpowiedniej wilgotności [8]. Przykładem może być choćby firma Apple, która w raporcie Greenpeace oceniającym gigantów technologicznych pod kątem „zielonych” rozwiązań [10] uzyskała ocenę A w kategorii „Efektywność energetyczna i ograniczenie emisji gazów cieplarnianych” m.in. za decyzję o ulokowaniu centrum danych w północnych szerokościach geograficznych – w tym wypadku w Danii, niedaleko miasta Viborg – ze względu na możliwość wykorzystania chłodzenia powietrzem zewnętrznym. Według tego samego raportu ocenę C uzyskał chiński gigant e-commerce Alibaba, m.in. za centrum danych w Zhangbei, które wyróżnia się efektywnym wykorzystaniem free coolingu – średnia temperatura w tamtej okolicy wynosi 2,6°C, a wysoka jakość powietrza zewnętrznego (dobre parametry są tam odnotowywane przez 344 dni w roku) ma dodatkowo pozytywny wpływ na trwałość serwerów [10].

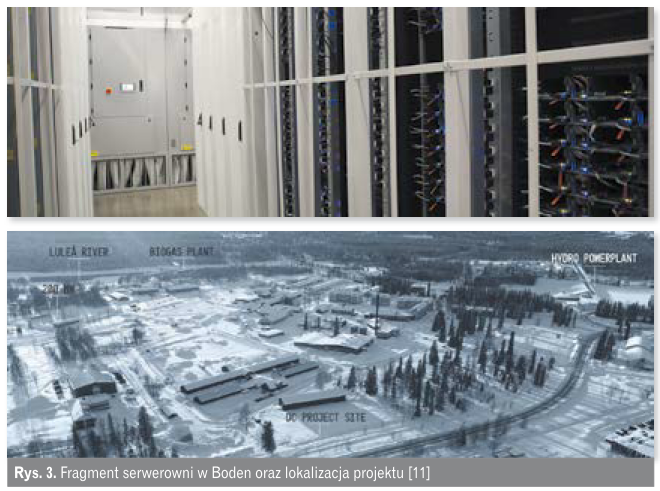

Dobroczynny wpływ dalekiej Północy na efektywność systemu chłodzenia, a tym samym wskaźnik PUE (Power Usage Effectiveness – całkowita energia obiektu odniesiona do energii zużywanej przez urządzenia IT) potwierdzają właśnie instytucje zaangażowane w międzynarodowy projekt Boden Type Data Centre (BTDC Project), dofinansowany przez Unię Europejską. Ma on doprowadzić do wypracowania zasad inżynierskich, dzięki którym powstawać będą ekonomiczne kosztowo i efektywne energetycznie centra danych o niskim wpływie na środowisko [11].

Boden – nowy rodzaj centrum danych?

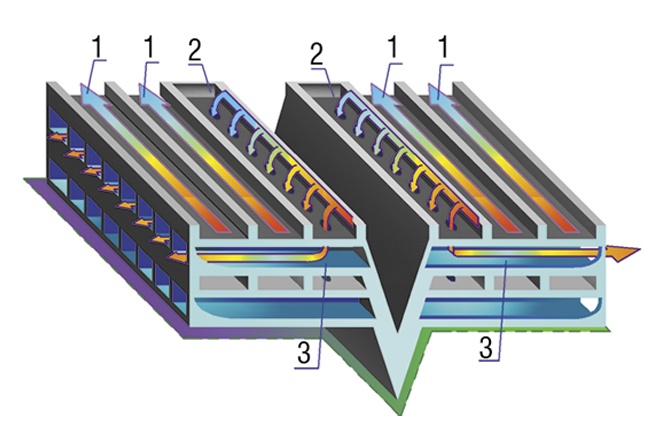

Boden to miejscowość w szwedzkiej Laponii – historycznej krainie najbardziej wysuniętej na północ. W projekcie Boden Type Data Centre (centrum danych typu Boden) zastosowano tzw. holistyczne podejście projektowe – zintegrowane chłodzenie adiabatyczne z wykorzystaniem świeżego powietrza, budowa modułowa, energia elektryczna pochodząca ze źródeł odnawialnych, sprzyjające warunki klimatyczne oraz infrastruktura usługowa. Jako system klimatyzacyjny zaplanowano chłodzenie bezpośrednie powietrzem zewnętrznym, któremu sprzyja średnia roczna temperatura powietrza w Boden (2°C), uzupełnione chłodzeniem ewaporacyjnym przy wyższej temperaturze zewnętrznej, z całkowitym wyeliminowaniem chłodzenia opartego na systemie sprężarkowym.

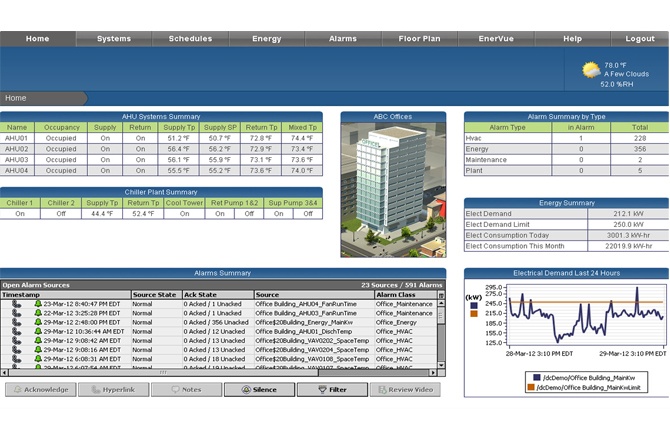

Ważnym elementem systemu chłodzenia jest odpowiednie sterowanie, które łączy urządzenia chłodzące z serwerami i pozwala regulować wydajność chłodniczą zależnie od zmieniającego się obciążenia cieplnego poszczególnych serwerów, a także od stopnia zapełnienia serwerowni [12]. Ten ostatni czynnik to właśnie element podejścia „holistycznego”. W realizowanej w czasie rzeczywistym wymianie danych serwery przekazują do systemów chłodniczych informacje o temperaturze procesorów centralnych (CPU) i prędkości wentylatorów, a urządzenia chłodnicze dostosowują do tego moc chłodniczą. Dzięki temu zużycie energii elektrycznej jest zoptymalizowane (energia jest wprost proporcjonalna do kwadratu prędkości obrotowej wentylatora), a efektywność energetyczna systemu chłodzenia wzrasta. Przez 30 dni pracy zgodnie z tym scenariuszem średnia wartość wskaźnika PUE dla badanego pomieszczenia wynosiła 1,03 [13]. Według założeń projektu efektywność układu CPU–system chłodzenia można dodatkowo zwiększyć, stabilizując temperaturę CPU (zwykle, zależnie od obciążenia, od 40 do 80°C), np. zapewniając odpowiedni rozkład obciążenia serwerów [12].

Ciekawym uzupełnieniem projektu BTDC jest współpraca z twórcami projektu Arctiq DC, w ramach którego badano możliwości wykorzystania ciepła odpadowego odebranego przez urządzenia chłodnicze w suszarni biomasy drzewnej [14].

„Chłodzenie holistyczne” może być, według autorów projektu, wprowadzone także w innych warunkach klimatycznych przy dostosowaniu oprogramowania:

- serwery udostępniają dane dotyczące przepływu powietrza lub prędkości wentylatorów, co daje systemowi chłodzenia (niezależnie od jego charakteru) możliwość synchronizacji;

- istnieje opcja pracy w niskiej temperaturze – wentylatory mogą automatycznie przechodzić na niższe obroty, gdy nawiewane jest powietrze o niższej temperaturze [11].

Warto dodać, że na rynku dostępne są rozwiązania (zarówno oprogramowanie, jak i zintegrowane układy zwiększające niezawodność centrów danych), które korzystają przynajmniej po części z wniosków projektowych. Mowa tu np. o regulacji prędkości wentylatorów czy rozwiązaniach typu BMS (niedawno wspólne kompleksowe rozwiązanie zapowiedziały choćby firmy Honeywell i Vertiv [15]) zapewniających zużycie energii elektrycznej dostosowujące się do konkretnych potrzeb poszczególnych urządzeń w obiekcie.

Ponieważ nawet przy tych zastrzeżeniach nadal nie każde centrum danych ulokowane jest w warunkach sprzyjających free coolingowi, ważnym aspektem związanym z oszczędnością energii jest wykorzystanie odnawialnych źródeł energii do produkcji prądu zasilającego centrum danych. Postawił na to m.in. amerykański operator kolokacyjny Switch. Firma zasila swoje centra danych w Nevadzie w 100% za pomocą OZE – korzysta z sieci, do której lokalni dostawcy energii odnawialnej przekazują wyprodukowaną energię. Z tego powodu zarówno zasilanie serwerów o wysokiej gęstości, jak i układu chłodzenia powietrzem (PUEśr = 1,23) jest efektywne energetycznie, mimo że lokalne warunki pogodowe nie umożliwiają korzystania z dobrodziejstw free coolingu [9].

Czy można ufać OZE?

Uptime Institute wymienia wytwarzanie lub kupowanie energii ze źródeł odnawialnych jako jeden z trzech głównych filarów zwiększania efektywności energetycznej przez centrum danych (dwa pozostałe to odpowiedni „park” serwerów i wykorzystanie ciepła odpadowego z serwerów do celów grzewczych) [1]. Wdrażane w praktyce i badane są najróżniejsze źródła.

Norweski dostawca usług kolokacyjnych, firma Green Mountain, w jednym ze swoich centrów danych korzysta z wody z pobliskiego fiordu – jest to całoroczne źródło wody o temperaturze 8°C [16]. Rozwiązanie to, obejmujące stację chłodzenia, rurociągi wody chłodzącej i pompy cyrkulacyjne, jest redundantne (w modelu N+N). Dzięki zastosowaniu wody z fiordu do wyprodukowania 100 kW mocy chłodniczej potrzeba 1 kW energii elektrycznej. Dodatkowym zabezpieczeniem jest podłączenie do trzech niezależnych urządzeń chłodniczych. Rozwiązanie stosowane jest do zasilania urządzeń chłodzących w architekturze rzędowej, z zastosowaniem gorących korytarzy [16].

Alibaba w swoim centrum w Qiandaohu używa do chłodzenia wody z pobliskiego naturalnego jeziora [17,18,19]. Przez 90% czasu centrum może być chłodzone z wykorzystaniem free coolingu, co zapewnia ok. 80% oszczędności energii w porównaniu do chłodzenia mechanicznego [19]. Woda z jeziora jest filtrowana mechanicznie, a po całym procesie podgrzana woda powrotna wraca do jeziora przez ok. 2,5-kilometrowy kanał wiodący przez dzielnicę miasta Qingxi. Planowane jest wykorzystanie ciepła zawartego w tej wodzie do ogrzewania pobliskich budynków. Ciepło odpadowe z serwerów wykorzystywane jest do ogrzewania biur na terenie centrum [17, 18, 19].

W Chinach przebadano agregat absorpcyjny, w którym czynnikiem chłodniczym jest mieszanina bromku litu z wodą (LiBr/H2O), a źródłem ciepła zaawansowany system geotermalny, oparty na opuszczonych studniach umożliwiających pobór wody gruntowej o temperaturze ok. 150°C [20]. Badacze wskazują na przewagę energii geotermalnej nad np. słoneczną czy z ciepła odpadowego jako cechującą się dużą wydajnością, niezależnością od warunków zewnętrznych i niezmiennością nie tylko w ciągu roku, ale też w skali ok. 20 lat (jest to konieczne, by zapewnić ciągłość pracy centrum danych). Ich zdaniem w miejscach, gdzie dostępna jest energia geotermalna, warto wziąć pod uwagę takie rozwiązanie, jednocześnie stabilne i zapewniające znaczne oszczędności energii nawet dla dużego centrum danych [20].

Coraz ważniejszym trendem, na który wskazuje m.in. Uptime Institute [1], staje się szeroko pojęte wykorzystanie ciepła odpadowego z serwerów. Coraz więcej firm wdraża w swoich centrach danych odzysk tego ciepła, przeznaczając jego zyski na ogrzewanie biur lub innych pomieszczeń pracowniczych na terenie obiektu. Można jednak pójść dalej – przykładem może być firma Apple. We wspomnianym już centrum danych w Danii ciepło odpadowe stosowane jest do zasilania lokalnej sieci komunalnej, co ma ograniczyć ogólne zużycie paliw kopalnych i zwiększyć efektywność energetyczną nie tylko centrum danych, ale całej okolicy [10]. Na mocy odpowiednich umów centrum danych może uzyskać za dostawę energii odpowiednie gratyfikacje, kompensujące wydatki na zakup energii elektrycznej.

Czy można wyciągnąć uniwersalne wnioski?

Przyglądając się trendom w chłodzeniu centrów danych jako rozwiązań coraz bardziej efektywnych ekonomicznie, nie można zapomnieć o kluczowej sprawie – wdrażanie choćby najlepszych praktyk, wypracowanych przez uznane instytucje, musi odbywać się w ścisłym porozumieniu z działem IT, z uwzględnieniem specyfiki pracy serwerów.

Warto niejako ku przestrodze przytoczyć „antystudium” przypadku z 2014 roku opisanego przez ekspertów Uptime Institute [21]. Po przeprowadzonym w nienazwanym centrum danych audycie instalacji chłodzącej (70 klimatyzatorów zasilanych wodą lodową) we wstępnej ocenie zapisano, że (uwzględniając redundancję) do chłodzenia tego centrum wystarczy zaledwie połowa wykorzystywanych urządzeń. Po otrzymaniu tej oceny pracownicy techniczni zaczęli w niekontrolowany i przypadkowy sposób wyłączać urządzenia chłodzące. Już po kilku minutach nastąpiło awaryjne wyłączenie krytycznych serwerów – czujniki ochronne wykryły, że temperatura przekroczyła wartość graniczną, konieczne było natychmiastowe ponowne włączenie wszystkich urządzeń. Po tym doświadczeniu nie podjęto ponownie działań na rzecz optymalizacji chłodzenia [20].

Ten przykład pokazuje, że jakiekolwiek działania w środowisku centrum danych wymagają planowego, starannego podejścia, przy współpracy wszystkich działów. Jak uczą badacze z projektu BTDC – konieczne jest podejście holistyczne.

Literatura

- Lawrence Andy, Ascierto Rhonda, 2020 Data Center Industry Survey, Uptime Institute, 2020, https://uptimeinstitute.com/publications/asset/2020-data-center-industry-survey

- Lachapelle Alan, Improving Performance in Ever-Changing Mission-Critical IT Infrastructures, Uptime Institute, 2015, https://journal.uptimeinstitute.com/improving-performance-ever-changing-mission-critical-infrastructures/

- Shehata Hussein, Data Center Cooling: CRAC/CRAH redundancy, capacity, and selection metrics, https://journal.uptimeinstitute.com/data-center-cooling-redundancy-capacity-selection-metrics/

- Rasmussen Neil, Strategie chłodzenia serwerów kasetowych i szaf o bardzo wysokiej gęstości, „White Paper” 46, Schneider Electric, 2010, https://www.apc.com/pl/pl/download/document/SPD_SADE-5TNRK6_PL/

- Janus Rafał, Nowoczesne chłodzenie i zasilanie centrum danych, „ITwiz” 9/2017.

- Dunlap Kevin, Rasmussen Neil, Wybór między chłodzeniem pomieszczeń, rzędów i szaf w centrach danych, „White Paper” 130, Schneider Electric, 2012, https://www.apc.com/pl/pl/download/document/SPD_VAVR-6J5VYJ_PL/

- Klesner Keith, Economizers in Tier Certified Data Centers, https://journal.uptimeinstitute.com/implications-of-economizers-in-tier-certified-data-centers/

- Liu Yanan et al., Energy consumption and emission mitigation prediction based on data center traffic and PUE for global data centers, „Global Energy Interconnection”, Vol. 3, No. 3/2020, p. 272–282, DOI: 10.1016/j.gloei.2020.07.008.

- Avgerinou Maria, Bertoldi Paolo, Castellazzi Luca, Trends in Data Centre Energy Consumption under the European Code of Conduct for Data Centre Energy Efficiency, „Energies” 10/2017, DOI: 10.3390/en10101470.

- Cook Gary, Clicking Clean: Who is Winning the race to build a green internet?, Greenpeace, 2017.

- Beresford Alan, Summer Jon, What knowledge can we apply from building the World’s most efficient conventional data centre, https://bodentypedc.eu/upload/images/publications/ny-/Boden-Type-DC-Project-Presentation-19-Oct-2020.pdf

- Boden Type DC Cooling Innovation, Boden 2020, https://bodentypedc.eu/about/features-findings

- Herzog Reinhard, Summers Jon, Batz Thomas, BodenType Data Center One – Performance Measurements,https://fordatis.fraunhofer.de/handle/fordatis/171

- BTDC partners with Arctiq DC to experiment waste heat utilization , 2020, https://bodentypedc.eu/news-calendar/news/21--btdc-partners-with-arctiq-dc-to-experiment-waste-heat-utilization

- Marszycki Mikołaj, Vertiv i Honeywell ujednolicą zarządzanie energią dla mikrosieci centrów danych, https://itwiz.pl/vertiv-honeywell-ujednolica-zarzadzanie-energia-dla-mikrosieci-centrow-danych/

- Heslin Kevin, Tier III Certified Facilities Prove Critical to Norwegian Colo’s Client Appeal, Uptime Instutite, 2016, https://journal.uptimeinstitute.com/tier-iii-certified-facilities-prove-critical-norwegian-colos-client-appeal/

- Luo Laura, Alibaba launches $2.9bn cloud base in North China, https://www.datacenterdynamics.com/en/news/alibaba-launches-29bn-cloud-base-in-north-china/

- AliCloud Launches New Energy-Efficient Qiandao Lake Data Center, https://www.businesswire.com/news/home/20150908005493/en/AliCloud-Launches-New-Energy-Efficient-Qiandao-Lake-Data-Center

- China Data Center Tour: Alibaba Qiandaohu Data Center, http://www.idcnova.com/html/1/59/153/710.html

- Han Bingbing et al., Study on Libr/H2O absorption cooling system based on enhanced geothermal system for data center, „Energy Reports” 6/2020, Supplement 9, p. 1090–1098, DOI: 10.1016/j.egyr.2020.11.072.

- Turner Pitt, Klesner Keith, Orr Ryan, Implementing Data Center Cooling Best Practices, Uptime Instutite, 2014, https://journal.uptimeinstitute.com/implementing-data-center-cooling-best-practices/